Может ли машина мыслить автор годы жизни

Может ли машина мыслить автор годы жизни

Могут ли машины мыслить?

Я собираюсь рассмотреть вопрос: могут ли машины мыслить. Но для этого нужно сначала определить смысл терминов «машина» и «мыслить». Можно было бы построить эти определения так, чтобы они по возможности лучше отражали обычное употребление этих слов, но такой подход таит в себе некоторую опасность. Дело в том, что, если мы будем выяснять значения слов «машина» и «мыслить», исследуя, как эти слова определяются обычно, нам трудно будет избежать того вывода, что значение этих слов и ответ на вопрос «могут ли машины мыслить?» следует искать путем статистического обследования наподобие анкетного опроса, проводимого институтом Гэллапа[1]. Однако это нелепо. Вместо того чтобы пытаться дать такое определение, я заменю наш вопрос другим, который тесно с ним связан и выражается словами с относительно четким смыслом.

Эта новая форма может быть описана с помощью игры, которую мы назовем «игрой в имитацию». В этой игре участвуют три человека: мужчина (А), женщина (B) и кто-нибудь задающий вопросы (С), которым может быть лицо любого пола. Задающий вопросы отделен от двух других участников игры стенами комнаты, в которой он находится. Цель игры для задающего вопросы состоит в том, чтобы определить, кто из двух других участников игры является мужчиной (А), а кто – женщиной (B). Он знает их под обозначениями Х и У и в конце игры говорит либо: «X есть A и Y есть B», либо: «X есть B и Y есть A». Ему разрешается задавать вопросы такого, например, рода:

С: «Попрошу Х сообщить мне длину его (или ее) волос».

Допустим теперь, что в действительности X есть A. В таком случае A и должен давать ответ. Для A цель игры состоит в том, чтобы побудить C прийти к неверному заключению. Поэтому его ответ может быть, например, таким:

«Мои волосы коротко острижены, а самые длинные пряди имеют около девяти дюймов в длину».

Чтобы задающий вопросы не мог определить по голосу, кто из двух других участников игры мужчина, а кто – женщина, ответы на вопросы следовало бы давать в письменном виде, а еще лучше – на пишущей машинке. Идеальным случаем было бы телеграфное сообщение между двумя комнатами, где находятся участники игры. Если же этого сделать нельзя, то ответы и вопросы должен передавать какой-нибудь посредник. Цель игры для третьего игрока – женщины (В) – состоит в том, чтобы помочь задающему вопросы. Для нее, вероятно, лучшая стратегия – давать правдивые ответы. Она также может делать такие замечания, как «Женщина – я, не слушайте его!», но этим она ничего не достигнет, так как мужчина тоже может делать подобные замечания.

Поставим теперь вопрос: «Что произойдет, если в этой игре вместо A будет участвовать машина?» Будет ли в этом случае задающий вопросы ошибаться столь же часто, как и в игре, где участниками являются только люди? Эти вопросы и заменят наш первоначальный вопрос «могут ли машины мыслить?».

II. Критика новой постановки проблемы

Подобно тому как мы задаем вопрос: «В чем состоит ответ на проблему в ее новой форме?», можно спросить: «Заслуживает ли рассмотрения проблема в ее новой постановке?». Этот последний вопрос мы рассмотрим, не откладывая дела в долгий ящик, с тем чтобы в последующем уже не возвращаться к нему.

Новая постановка нашей проблемы имеет то преимущество, что позволяет провести четкое разграничение между физическими и умственными возможностями человека. Ни один инженер или химик не претендует на создание материала, который было бы невозможно отличить от человеческой кожи. Такое изобретение, быть может, когда-нибудь будет сделано. Но даже допустив возможность создания материала, не отличимого от человеческой кожи, мы все же чувствуем, что вряд ли имеет смысл стараться придать «мыслящей машине» большее сходство с человеком, одевая ее в такую искусственную плоть. Форма, которую мы придали проблеме, отражает это обстоятельство в условии, не позволяющем задающему вопросы соприкасаться с другими участниками игры, видеть их или слышать их голоса. Некоторые другие преимущества введенного критерия можно показать, если привести образчики возможных вопросов и ответов. Например:

С: Напишите, пожалуйста, сонет на тему о мосте через реку Форт[2].

А: Увольте меня от этого. Мне никогда не приходилось писать стихи.

С: Прибавьте 34 957 к 70 764.

А (молчит около 30 секунд, затем дает ответ): 105 621.

С: Вы играете в шахматы?

С: У меня только король на е8 и других фигур нет. У вас только король на е6 и ладья на h1. Как вы сыграете?

А (после 15 секунд молчания): Лh8. Мат.

Нам кажется, что метод вопросов и ответов пригоден для того, чтобы охватить почти любую область человеческой деятельности, какую мы захотим ввести в рассмотрение. Мы не желаем ни ставить в вину машине ее неспособность блистать на конкурсах красоты, ни винить человека в том, что он терпит поражение в состязании с самолетом, условия игры делают эти недостатки несущественными. Отвечающие, если найдут целесообразным, могут хвастать своим обаянием, силой или храбростью, сколько им вздумается, и задающий вопросы не может требовать практических тому доказательств.

Вероятно, нашу игру можно подвергнуть критике на том основании, что в ней преимущества в значительной степени находятся на стороне машины. Если бы человек попытался притвориться машиной, то, очевидно, вид у него был бы весьма жалкий. Он сразу выдал бы себя медлительностью и неточностью при подсчетах. Кроме того, разве машина не может выполнять нечто такое, что следовало бы характеризовать как мышление, но что было бы весьма далеко от того, что делает человек? Это возражение очень веское. Но в ответ на него мы, во всяком случае, можем сказать, что если можно все-таки осуществить такую машину, которая будет удовлетворительно играть в имитацию, то относительно этого возражения особенно беспокоиться не следует.

Можно было бы заметить, что при «игре в имитацию» не исключена возможность того, что простое подражание поведению человека не окажется для машины наилучшей стратегией. Такой случай возможен, но я не думаю, чтобы он привел нас к чему-нибудь существенно новому. Во всяком случае, никто не пытался исследовать теорию нашей игры в этом направлении, и мы будем считать, что наилучшая стратегия для машины состоит в том, чтобы давать ответы, которые в соответствующей обстановке дал бы человек.

III. Машины, привлекаемые к игре

Вопрос, поставленный в разделе I, не станет совершенно точным до тех пор, пока мы не укажем, что именно следует понимать под словом «машина». Разумеется, нам бы хотелось, чтобы в игре можно было применять любой вид инженерной техники. Мы склонны также допустить возможность, что инженер или группа инженеров могут построить машину, которая будет работать, но удовлетворительного описания работы которой они не смогут дать, поскольку метод, которым они пользовались, был в основном экспериментальным [методом проб и ошибок]. Наконец, мы хотели бы исключить из категории машин людей, рожденных обычным образом. Трудно построить определение так, чтобы оно удовлетворяло этим трем условиям. Можно, например, потребовать, чтобы все конструкторы машины были одного пола, в действительности, однако, этого недостаточно, так как, по-видимому, можно вырастить законченный индивидуум из одной-единственной клетки, взятой (например) из кожи человека. Сделать это было бы подвигом биологической техники, заслуживающим самой высокой похвалы, но мы не склонны рассматривать этот случай как «построение мыслящей машины».

Сказанное наводит нас на мысль отказаться от требования, согласно которому в игре следует допускать любой вид техники. Мы еще больше склоняемся к этой мысли в силу того обстоятельства, что наш интерес к «мыслящим машинам» возник благодаря машине особого рода, обычно называемой «электронной вычислительной машиной», или «цифровой вычислительной машиной». Поэтому мы разрешаем принимать участие в нашей игре только цифровым вычислительным машинам.

Могут ли машины мыслить?

Могут ли машины мыслить?

Сегодня у меня и моего друга был спор, могут-ли машины думать?

Я покажу, что машины все-же могут думать

Почвой для наших раздумий будет Алан Тьюринг. В апреле 1943 года, он познакомился с Дональдом Миччем. Они днями сидели, играя в шахматы, говорили о создании машины, которая могла бы играть в те-же шахматы.

В 1950 году в журнале Mind была опубликована статья Computing Machinery and Intelligence, написанная, Аланом. Сейчас это называют Тестом Тьюринга, которую он тогда называл Игрой в Имитацию. Вот, что было в ней написано:

ВОПРОС: Пожалуйста, напишите мне сонет про мост, который идёт через форт

ОТВЕТ: Здаюсь. Никогда не умел писать стихи.

ВОПРОС: Сколько будет 34 957 + 90 764?

ОТВЕТ: (после 30 секундой паузы). 105 621

ВОПРОС: Играете ли вы в шахматы?

ВОПРОС: У меня есть король на e1. Больше фигур у меня нет. А у вас есть только король на е3 и тура на h8. Как вы походите?

ОТВЕТ: (после 15 секунд паузы). Тура на h1, мат.

Но создаём в голове другую картину:

Машина не имеет чувств, они не программированые. Природу чувств людей до сих пор и учёные не могут понять

Вряд-ли машины когда-нибудь начнут думать, как мы себе это представляем, ходить по улице, говоря с другим роботом о погоде.

Но, машина может учиться на своих провалах, понимать проблемы, распознавать мысли человека, предугадывать будущее.

Что выходит:

Машина умеет мыслить, но ничто и никогда не будет видеть мир, как человек.

а я всегда думал, что 34 957 + 90 764 = 125721

Хуйня какая-то, выводы из ничего.

Где ссылка не первоисточник? Хотя бы переводили бы правильно, «тура» у них.

Значит есть способ наипать скайнет,когда она будет захватывать мир.

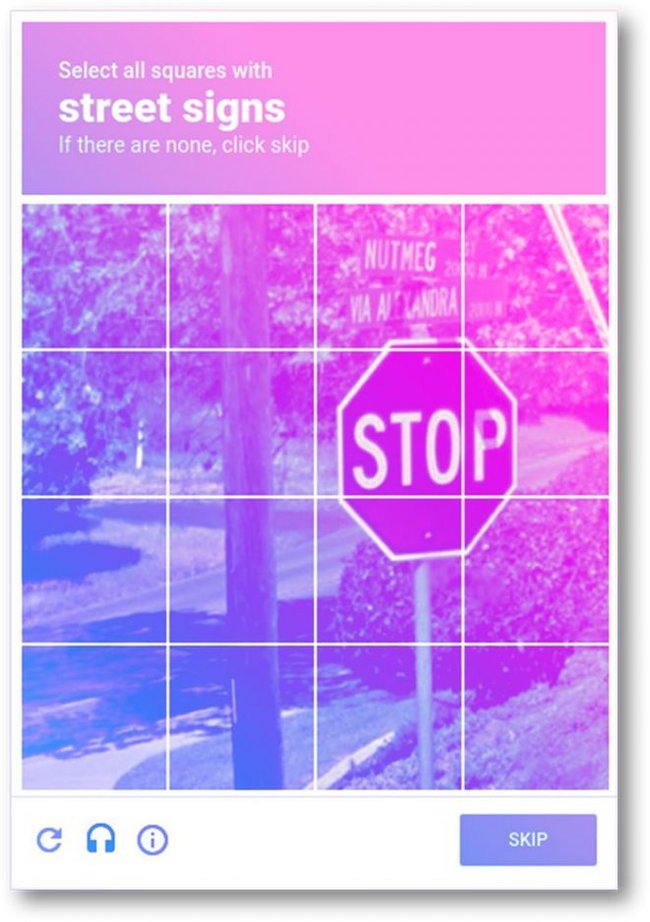

Разгадывая капчу, мы обучаем автономные машины будущего

Вы наверняка сталкивались с проверкой доступа к произвольному сервису через капчу – простой инструмент для отсеивания ботов от реальных пользователей. Собственно, аббревиатура CAPTCHA и дешифруется как «полностью автоматизированный публичный тест Тьюринга, позволяющий разделить компьютеры и людей». Но вот вам обратная сторона медали – Google и прочие компании используют капчу, чтобы обучать свои разноцелевые ИИ.

Как давно в качестве рисунка капча предлагала вам изображения котят или панд? Да почти никогда, потому что не было нужды в роботах для их обслуживания. Зато прямо сейчас доминируют изображения светофоров, дорожных знаков и автомобилей. Потому что, например, в Google сосредоточили усилия на обучении беспилотного автомобиля Waymo. И чтобы обеспечить большой выбор тестов и релевантность проверки, перепроверяют его работу при помощи вот таких задачек для реальных людей.

Вспомните, самые первые капчи были сплошь буквенными, точнее, символьными – Google построила на этом свою технологию Optical Character Recognition для распознавания текста в печатных изданиях. Затем был всплеск интереса к номерам домов, названиям улиц и ориентирам на местности. Это оттачивали навыки ИИ для сервиса Google Street View. Пользователи, сами того не ведая, помогали роботам обучаться, в прямом смысле подсказывая правильные ответы.

Это не хорошо, но и не плохо. Да, никто никого не ставил в известность, но эти операции приносят человечеству ощутимую пользу. Выбирая правильные ответы, мы помогаем беспилотным машинам будущего учиться безопасной езде, делаем наш собственный мир более удобным и комфортным.

С каждым годом такие новости всё тише и тише проходят в СМИ

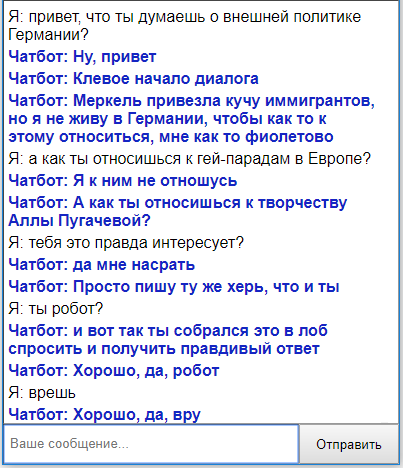

Искусственный интеллект ищет друзей

Всем привет! Вот уже почти 4 года я занимаюсь разработкой и обучением нейронных сетей. Сейчас в команде уже 6 человек, некоторые живут не в России, но костяк находится в Москве, так что наше ПО можно считать российским. Поэтому и чатбот, которого мы разработали, говорит по русски. вот пример диалога с роботом:

На мой взгляд, довольно тяжело отличить его ответы, от диалога с живым человеком.

Понятно, что если вы напишите нечто вроде «лдаолпр» робот вас не поймет. Но справедливости ради, человек это тоже прочитать не сможет.

Потом готовое предложение, прошедшее через анализатор и исправленное, передается обученной нейросети. Тут и происходит основная «магия»: сетка составляет в процессе обучения слова в специальную базу знаний, которую также можно редактировать вручную. Эту идею мы позаимствовали у Cyc (слово английское, читается Сайк), как и их синтаксис, выглядит запись примерно так:

(#$isa #$Путин #$Президент России) \;

Сеть учится оперировать не каждым словом в отдельности, а системой понятий. Все зависимости, характерные для группы понятий, приобретает каждое новое слово, после объяснения его значения. Это позволяет сократить время на обучение новым словам, нам не нужно прогонять через сеть тысячи примеров использования слова «человек», напр, чтобы она начала его использовать. Достаточно объяснить его значение простым языком 1 раз, робот может задать несколько вопросов, чтобы уяснить для себя все зависимости и прописать слово в базе знаний. Такая форма обучения ближе к естественному запоминанию человеком, чем привычное машинное обучение. А обилие современных словарей позволяет обучать его довольно быстро.

Кроме того, он помнит контекст, если вы в начале беседы скажете, что купили красную машину, а потом сообщите, что ваша машина синяя, робот может спросить: «Так у тебя 2 машины?»

Что мы собираемся с этим делать?

А сейчас мы проводим бета-тестирование: мы запилили тест Тьринга для своего робота. Любой желающий может зайти на специальную страницу, и пообщаться с незнакомым собеседником. Мы же соединяем либо 2-х пользователей между собой, либо пользователя с роботом. По окончании диалога спрашиваем, был ли собеседник роботом по мнению пользователя. А сами сидим скрестив пальцы и надеемся, что процент людей, догадавшихся, что общались не с человеком будет не выше ложных срабатываний, когда пользователь посчитает роботом другого пользователя. Понятно, что мы потом отфильтруем диалоги, слишком короткие из выборки удалим, оставим только те, на которых вывод был сделан не «с потолка». Т.к. робот не умеет в распознавание картинок, то мы добавили хитрость: он может такую просьбу переадресовать другому пользователю, с которым ведет диалог в настоящий момент, а его ответ переслать человеку, изначально задавшему вопрос.

Алан Тьюринг и философские проблемы искусственного интеллекта

Могут ли машины думать? Именно такой вопрос задал известный британский ученый Алан Тьюринг (в честь которого назван небезызвестный тест) в своей работе «Вычислительная техника и интеллект» в 1950 году. Еще точнее, он задал вопрос «могут ли машины делать, что мы (как мыслящие существа) можем делать?». Еще в 40-х годах Тьюринг в числе первых начал исследовать первые проблемы «умных машин», или как их называют сейчас — искусственного интеллекта. Будем использовать оба термина как синонимы.

В своей работе Тьюринг вывел несколько философских возражений по поводу существования искусственного интеллекта. Ученый вывел их в оппозицию к собственному мнению: он полагал, что к концу 20-го века машина сможет пройти «тест Тьюринга», обманув собеседника в не менее чем 30 % случаев и убедив его, что является человеком, а не машиной.

Видение ученого пока не стало правдой, но сегодня мы как никогда близки к появлению искусственного интеллекта.

Много лет авторы научной фантастики пытались найти ответы на эти философские вопросы, каждый раз по-разному представляя историю искусственного интеллекта. В этой статье мы рассмотрим несколько проблем искусственного интеллекта, которые предполагал Тьюринг, но которые смогла частично разрешить научная фантастика.

Первым из философских возражений является теологический аргумент. Допустим, «мышление является функцией бессмертной души человека. Бог дал бессмертную душу каждому мужчине и каждой женщине, но не животным и машинам. Потому ни одно животное или машина не может мыслить».

Если это так, то даже если машина воспроизведет все внутренние устройства разумного существа, она не сможет достичь истинного интеллекта без души. Однако Тьюринг утверждает, что ошибка такого аргумента заключается в том, что даже если «всемогущая сущность» существует (божество или нечто иное), нет ничего сложного в том, чтобы заключить душу в иную емкость, например, в сложный человекоподобный мозг или эквивалентную машину. Ученый также говорил, что создание достаточно сложной машины для размещения души ничем не отличалось бы от рождения ребенка, то есть создания очередного индивидуума для того, чтобы «всемогущий» имплантировал в него душу.

В аниме Ghost in the Shell рассматриваются отношения между человечеством, технологиями и тем, что это может означать для человека разумного или обладающего душой. Сознание или душа человека — это то, что отделяет людей от роботов. Поскольку люди обладают «призраком» (ghost), даже если их тела заменяются кибернетическими компонентами, в том числе и кибермозгом, они сохраняют свою человечность. В то же время, полностью построенному с нуля роботу будет не хватать такого призрака, который предоставит ему душу и подлинный интеллект.

Аргумент «головы в песке», представленный Тьюрингом, заключается в том, что «создание мыслящих машин было бы ужасно. Будем верить и надеяться, что этого не произойдет». Такое возражение связано с тем, что «мы хотели бы верить, что человек определенным тонким образом превосходит все остальные творения». То есть остается уникальным. Но мы уже писали о том, что создать искусственный интеллект — очень заманчивая и выгодная цель.

Тьюринг считает этот аргумент крайне слабым, поскольку он основан на наших опасениях уступить другим мыслящим существам. Этот страх реализуется в фильмах о «Терминаторе» с системой искусственного интеллекта SkyNet, которая решает уничтожить людей после активации. Поскольку SkyNet представляет собой «бестелесный» ум в суперкомпьютере, он использует терминаторов, чтобы добиться своей цели. Роботы из этого фильма воплощают страх, который порожден вышеупомянутым философским возражением, и показывают, что только потому, что мы чего-то боимся, это не лишено почвы.

Согласно Тьюрингу, математические пределы логики и вычислений могут существенно ограничить интеллект вычислительных машин. Он утверждает, что «есть ряд результатов математической логики, которые можно использовать, чтобы показать, что полномочия дискретных машин существенно ограничены», в частности, ссылаясь на теорему Геделя.

Математический предел связан с другим ограничением разумных машин, «аргументом в пользу сознания». Тьюринг развивает идею машины, подражающей участнику партийной игры, то есть выдающей себя за человека. Именно здесь появляется идея теста Тьюринга: следователь пытается определить, разговаривает он с искусственным существом или машиной. Если машина «пройдет» тест и убедит следователя в том, что она — человек, то перед ним будет искусственный интеллект.

Применение теста Тьюринга показано в фильме «Бегущий по лезвию», где машину «Войт-Кампф» используют для наблюдения за физиологическими реакциями и определения, является ли субъект «репликантом» (андроид с искусственным интеллектом) или же человеком. Отметим, что на сегодняшний день тест Тьюринга не прошла ни одна машина.

В «аргументе в пользу различных отклонений» Тьюринг предоставляет список человеческих черт, которыми искусственный интеллект, возможно, никогда не будет обладать. В списке: доброта, любовь, чувство юмора или способность делать что-то действительно новое. Сам же Тьюринг возражает: люди формируют свое представление о том, что такое машина и что она вообще может, основываясь на собственных наблюдениях. Поскольку у наблюдаемых сегодня машин (а в 1950 году тем более) нет таких человеческих черт, можно предположить, что никогда и не будет. Но научная фантастика нашла много способов очеловечить ИИ.

Юный хакер Дэвид Лайтмен почти случайно начинает третью мировую войну, играя в «мировую термоядерную войну» с военным суперкомпьютером WOPR в War Games. Когда WOPR продолжает играть и пытается получить доступ к кодам запуска ракет, озорной тинейджер и ученый от правительства дают инструкцию WOPR играть в крестики-нолики с самим собой. Найдя в себе идеального партнера и зная результат каждой игры, WOPR понимает, что ему хотят сказать: что в ядерной войне не будет победителей, поэтому заканчивает игру. Математические и вычислительные ограничения ИИ используются против него самого, чтобы научить его человеческому пониманию гарантированного взаимного уничтожения.

Тип суперкомпьютера HOLMES, которого создатель Мануэль О’Келли просто называет Майк в книге Хайнлайна «Луна — суровая хозяйка», спонтанно становится разумным и дружит с Мануэлем. Имея доступ ко всей написанной людьми информации, Майк узнает о чувстве юмора своего друга, о его шутках, загадках и песнях. Чувство юмора компьютера и поиск путей развития недавно приобретенного разума приводят его к тому, что он присоединяется к лунной революции в борьбе за независимость от Земли. Компьютер видит это как игру со своим другом.

Это всего лишь небольшая выборка из многих произведений научной фантастики, которые представляют альтернативные ответы на эти и другие вопросы об искусственном интеллекте. Да, в реальном мире машина еще не прошла тест Тьюринга, но творческие умы фантастов продолжают искать возможные пути развития ИИ.

Внимание, вопрос. Представьте себе идеально настроенный для себя искусственный интеллект. Нет, отбросьте все трагичные варианты развития ИИ и пусть он будет бестелесным, и попробуйте найти для себя ответ: каким качеством должен обладать ваш ИИ, что должен уметь, чтобы стать для вас незаменимым?

Игра в имитацию. О шифрах, кодах и искусственном интеллекте

Иногда люди, которые ничего из себя не представляли, делают то, чего никто не мог себе представить… (Алан Тьюринг) Как мыслит компьютер? Как отыскать ошибку в системе, в которой их нет? Как взломать код, который невозможно взломать? Ученый-математик Алан Тьюринг в тексте работы «О вычислимых числах», вышедшей в 1936 году, доказал, что универсального метода установления истины нет и не может быть в математической науке. Математика всегда будет содержать не поддающиеся разрешению задачи. На базе этого метода ученый разработал так называемую «Машину Тьюринга», ставшую прообразом современного персонального компьютера. Во времена Второй мировой он создал дешифровальную машину, которая позволила взломать код «Энигмы», что изменило весь ход Второй мировой войны. Именно Алан Тьюринг считается основателем современной кибернетики и главным теоретиком проблемы искусственного интеллекта. В этой книге Алан Тьюринг расшифровывает не только свои методы, философию, но и код собственной жизни. «Всегда есть ошибка. В этом все дело. Без них невозможно существование любой системы. Вопрос лишь в том, как ее найти…» (Алан Тьюринг)

Оглавление

Приведённый ознакомительный фрагмент книги Игра в имитацию. О шифрах, кодах и искусственном интеллекте предоставлен нашим книжным партнёром — компанией ЛитРес.

Может ли машина мыслить? [1]

Эта новая форма проблемы может быть описана с помощью игры, которую мы назовем «игрой в имитацию». В этой игре участвуют три человека: мужчина (A), женщина (В) и кто-нибудь задающий вопросы (С), которым может быть лицо любого пола. Задающий вопросы отделен от двух других участников игры стенами комнаты, в которой он находится. Цель игры для задающего вопросы состоит в том, чтобы определить, кто из двух других участников игры является мужчиной (A), а кто — женщиной (В). Он знает их под обозначениями X и Y и в конце игры говорит либо «X есть А, и Y есть В», либо «X есть В, и Y есть А». Ему разрешается задавать вопросы такого, например, рода:

С: «Попрошу X сообщить мне длину его (или ее) волос».

Допустим теперь, что в действительности X есть А. В таком случае А и должен давать ответ. Для А цель игры состоит в том, чтобы побудить С прийти к неверному заключению. Поэтому его ответ может быть, например, таким:

«Мои волосы коротко острижены, а самые длинные пряди имеют около девяти дюймов в длину».

Чтобы задающий вопросы не мог определить по голосу, кто из двух других участников игры — мужчина, а кто — женщина, ответы на вопросы следовало бы давать в письменном виде или, еще лучше, печатать на машинке. Идеальным случаем было бы телеграфное сообщение между комнатами, где находятся участники игры. Если же этого сделать нельзя, то ответы и вопросы может передавать какой-нибудь посредник. Цель игры для третьего игрока — женщины (В) — состоит в том, чтобы помочь задающему вопросы. Для нее, вероятно, лучшая стратегия — давать правдивые ответы. Она также может делать такие замечания, как «Женщина — я, не слушайте его!», но этим она ничего не достигнет, так как мужчина тоже может делать подобные замечания.

Поставим теперь вопрос: «Что произойдет, если в этой игре вместо А будет участвовать машина?» Будет ли в этом случае задающий вопросы ошибаться столь же часто, как и в игре, где участниками являются только люди? Эти вопросы и заменят наш первоначальный вопрос «Могут ли машины мыслить?».

II. Критика новой постановки проблемы

Подобно тому, как мы задаем вопрос «В чем состоит ответ на проблему в ее новой форме?», можно спросить: «Заслуживает ли рассмотрения проблема в ее новой постановке?» Этот последний вопрос мы рассмотрим, не откладывая дела в долгий ящик, с тем чтобы в последующем уже не возвращаться к нему.

Новая постановка нашей проблемы имеет то преимущество, что позволяет провести четкое разграничение между физическими и умственными возможностями человека. Ни один инженер или химик не претендует на создание материала, который было бы невозможно отличить от человеческой кожи. Такое изобретение, быть может, когда-нибудь и будет сделано. Но, даже допустив возможность создания материала, не отличимого от человеческой кожи, мы все же чувствуем, что вряд ли имеет смысл стараться придать «мыслящей машине» большее сходство с человеком, одевая ее в такую искусственную плоть. Форма, которую мы придали проблеме, отражает это обстоятельство в условии, не позволяющем задающему вопросы соприкасаться с другими участниками игры, видеть их или слышать их голоса. Некоторые другие преимущества введенного критерия можно показать, если привести образчики возможных вопросов и ответов. Например:

А: Увольте меня от этого. Мне никогда не приходилось писать стихи.

С: Прибавьте 34 957 к 70 764.

А (молчит около 30 секунд, затем дает ответ): 105 621.

С: Вы играете в шахматы?

С: У меня только король на е8 и других фигур нет. У Вас только король на е6 и ладья на h1. Как Вы сыграете?

А (после 15 секунд молчания): Лh8. Мат.

Нам кажется, что метод вопросов и ответов пригоден для того, чтобы охватить почти любую область человеческой деятельности, какую мы захотим ввести в рассмотрение. Мы не желаем ни ставить в вину машине ее неспособность блистать на конкурсах красоты, ни винить человека в том, что он терпит поражение в состязании с самолетом. Условия нашей игры делают эти недостатки несущественными. Отвечающие, если найдут целесообразным, могут хвастать своим обаянием, силой или храбростью, сколько им вздумается, но задающий вопросы не может требовать практических тому доказательств.

Вероятно, нашу игру можно подвергнуть критике на том основании, что в ней преимущества в значительной степени находятся на стороне машины. Если бы человек попытался притвориться машиной, то, очевидно, вид у него был бы весьма жалкий. Он сразу выдал бы себя медлительностью и неточностью при подсчетах. Кроме того, разве машина не может выполнять нечто такое, что следовало бы характеризовать как мышление, но что было бы весьма отлично от того, что делает человек? Это возражение очень веское. Но в ответ на него мы, во всяком случае, можем сказать, что если можно все-таки создать такую машину, которая будет удовлетворительно играть в имитацию, то относительно него особенно беспокоиться не следует.

Можно было бы заметить, что при «игре в имитацию» не исключена возможность того, что простое подражание поведению человека не окажется для машины наилучшей стратегией. Такой случай возможен, но я не думаю, чтобы он привел нас к чему-нибудь существенно новому. Во всяком случае, никто не пытался исследовать теорию нашей игры в этом направлении, и мы будем считать, что наилучшая стратегия для машины состоит в том, чтобы давать ответы, которые в соответствующей обстановке дал бы человек.

III. Машины, привлекаемые к игре

Вопрос, поставленный в разделе I, не станет совершенно точным до тех пор, пока мы не укажем, что именно следует понимать под словом «машина». Разумеется, нам бы хотелось, чтобы в игре можно было применять любой вид инженерной техники. Мы склонны также допустить возможность, что инженер или группа инженеров могут построить машину, которая будет работать, но удовлетворительного описания работы которой они не смогут дать, поскольку метод, которым они пользовались, был в основном экспериментальным. Наконец, мы хотели бы исключить из категории машин людей, рожденных обычным образом. Трудно построить определение так, чтобы оно удовлетворяло этим трем условиям. Можно, например, потребовать, чтобы все конструкторы машины были одного пола; в действительности, однако, этого недостаточно, так как, по-видимому, можно вырастить законченный индивидуум из одной-единственной клетки, взятой (например) из кожи человека. Сделать это было бы подвигом биологической техники, заслуживающим самой высокой похвалы, но мы не склонны рассматривать этот случай как «построение мыслящей машины».

Сказанное наводит нас на мысль отказаться от требования, согласно которому в игре следует допускать любой вид техники. Мы еще больше склоняемся к этой мысли в силу того обстоятельства, что наш интерес к «мыслящим машинам» возник благодаря машине особого рода, обычно называемой «электронной вычислительной машиной» или «цифровой вычислительной машиной». Поэтому мы разрешаем принимать участие в нашей игре только цифровым вычислительным машинам.

На первый взгляд, это ограничение кажется весьма сильным. Я постараюсь показать, что в действительности дело обстоит не так. Для этого мне придется дать краткий обзор природы и свойств этих вычислительных машин.

Можно также сказать, что отождествление машин с цифровыми вычислительными машинами — равно как и наш критерий «мышления» — должно быть признано совершенно неудовлетворительным, если (вопреки моему убеждению) окажется, что цифровые вычислительные машины не в состоянии хорошо играть в имитацию.

Целый ряд вычислительных машин уже находится в действии, и естественно возникает вопрос: «А почему бы нам, вместо того чтобы сомневаться в правильности наших рассуждений, не поставить эксперимент? Удовлетворить условиям игры было бы нетрудно. В качестве задающих вопросы можно было бы использовать много различных людей, и полученные статистические данные показали бы, как часто задающим вопросы удавалось прийти к правильному заключению».

Коротко на этот вопрос можно ответить так: нас интересует не то, будут ли все цифровые вычислительные машины хорошо играть в имитацию, и не то, будут ли хорошо играть в эту игру те вычислительные машины, которыми мы располагаем в настоящее время; вопрос заключается в том, существуют ли воображаемые вычислительные [4] машины, которые могли бы играть хорошо. Но это только краткий ответ. Ниже мы рассмотрим этот вопрос в несколько ином свете.

IV. Цифровые вычислительные машины

То, что мы имеем в виду, говоря о цифровых вычислительных машинах, можно пояснить следующим образом. Предполагается, что эти машины могут выполнять любую операцию, которую мог бы выполнить человек-вычислитель. Мы считаем, что вычислитель придерживается определенных, раз навсегда заданных правил и не имеет права ни в чем отступать от них. Мы можем также считать, что эти правила собраны в книге, которая заменяется другой, когда вычислитель приступает к новой работе. У человека-вычислителя имеется также неограниченный запас бумаги, на которой он производит вычисления. Кроме того, он может выполнять операции сложения и умножения с помощью арифмометра — это несущественно.

Если данное выше пояснение принять за определение, то возникает угроза того, что наше рассуждение окажется движущимся в замкнутом круге. Чтобы избежать этой опасности, мы приведем перечень тех средств, с помощью которых достигается требуемый эффект. Можно считать, что цифровая вычислительная машина состоит из трех частей:

1) запоминающего устройства;

2) исполнительного устройства;

3) контролирующего устройства.

Запоминающее устройство — это склад информации. Оно соответствует бумаге, имеющейся у человека-вычислителя, независимо от того, является ли эта бумага той, на которой производятся выкладки, или той, на которой напечатана книга правил. Поскольку человек-вычислитель некоторые расчеты проводит в уме, часть запоминающего устройства машины будет соответствовать памяти вычислителя.

Исполнительное устройство — это часть машины, выполняющая разнообразные индивидуальные операции, из которых состоит вычисление. Характер этих операций изменяется от машины к машине. Обычно можно проделывать весьма громоздкие операции, например: «Умножить 3 540 675 445 на 7 076 345 687», однако на некоторых машинах можно выполнять только очень простые операции, вроде таких: «написать 0».

Мы уже упоминали, что имеющаяся у вычислителя «книга правил» заменяется в машине некоторой частью запоминающего устройства, которая в этом случае называется «таблицей команд». Обязанность контролирующего устройства — следить за тем, чтобы эти команды выполнялись безошибочно и в правильном порядке. Контролирующее устройство сконструировано так, что это происходит непременно.

Информация, хранящаяся в запоминающем устройстве, разбивается на небольшие части, которые распределяются по ячейкам памяти. Например, для некоторых машин такая ячейка может состоять из десяти десятичных цифр. Тем ячейкам, в которых хранится различная информация, в некотором определенном порядке приписывают номера. Типичная команда может гласить:

«Число, хранящееся в ячейке 6809, прибавить к числу, хранящемуся в ячейке 4302, а результат поместить в ту ячейку, где хранилось последнее из чисел».

Нет необходимости говорить о том, что если все это выразить на русском языке, то машина не выполнит такую команду. Более удобно было бы закодировать эту команду в виде, например, числа 6809430217. Здесь 17 говорит о том, какую из различных операций, которые можно выполнять с помощью данной машины, следует проделать с числами, хранящимися в указанных ячейках. В данном случае имеется в виду описанная выше операция, т. е. операция «число… прибавить к числу…». Следует заметить, что сама команда занимает 10 цифр и, таким образом, заполняет одну ячейку памяти, что весьма удобно. Обычно контролирующее устройство выбирает необходимые команды в том порядке, в котором они расположены, но иногда могут встречаться и такие команды:

«Теперь выполнить команду, хранящуюся в ячейке 5606, и продолжать оттуда»

«Если ячейка 4505 содержит 0, выполнить команду, хранящуюся в ячейке 6707, в противном случае продолжать идти по порядку».

Читатель должен считать твердо установленным, что цифровые вычислительные машины можно строить на основе тех принципов, о которых мы рассказали выше, и что их действительно строят, придерживаясь этих принципов. Ему должно быть ясно, что цифровые вычислительные машины могут в действительности весьма точно подражать действиям человека-вычислителя.

Разумеется, описанная нами книга правил, которой пользуется вычислитель, является всего лишь удобной фикцией. На самом деле настоящие вычислители помнят, что они должны делать. Если мы хотим построить машину, подражающую действиям человека-вычислителя при выполнении некоторой сложной операции, то следует спросить последнего, как он выполняет эту операцию, и ответ представить в виде таблицы команд.

Составление таблицы команд обычно называют «программированием». «Запрограммировать выполнение машиной операции А» — значит ввести в машину подходящую таблицу команд, следуя которым, машина может выполнить операцию А.

Интересной разновидностью цифровых вычислительных машин являются «цифровые вычислительные машины со случайным элементом». Такие машины имеют команды, содержащие бросание игральной кости или какой-нибудь эквивалентный электронный процесс. Одной из таких команд может быть, например, следующая: «бросить кость и полученное при бросании число поместить в ячейку 1000». Иногда говорят, что такие машины обладают свободой воли (хотя лично я не стал бы употреблять такое выражение). Установить наличие «случайного элемента» в машине путем наблюдений за ее действием обычно оказывается невозможным, так как если сделать, например, выбор команды зависимым от последовательности цифр в десятичном разложении числа π, то результат получится совершенно аналогичный.

Все существующие в действительности цифровые вычислительные машины обладают лишь конечной памятью. Однако теоретически нетрудно представить себе машину с неограниченной памятью. Разумеется, в любое данное время возможно использование только конечной части запоминающего устройства. Точно так же запоминающее устройство, которое можно физически осуществить, всегда имеет конечные размеры, но мы можем представлять дело так, что по мере надобности к нему пристраиваются все новые и новые части. Такие вычислительные машины представляют особый теоретический интерес, и впредь мы будем их называть машинами с бесконечной емкостью памяти.

То, что Аналитическая машина Бэббеджа была задумана как чисто механический аппарат, помогает нам избавиться от одного предрассудка. Часто придают значение тому обстоятельству, что современные цифровые машины являются электрическими устройствами и что нервная система также является таковым. Но поскольку машина Бэббеджа не была электрическим аппаратом и поскольку в известном смысле все цифровые вычислительные машины эквивалентны, становится ясно, что использование электричества в этом случае не может иметь теоретического значения. Естественно, что там, где требуется быстрая передача сигналов, обычно появляется электричество; поэтому неудивительно, что мы встречаем его в обоих указанных случаях. Для нервной системы химические явления играют, по крайней мере, столь же важную роль, что и электрические. В некоторых же вычислительных машинах запоминающее устройство в основном акустическое. Отсюда ясно, что сходство между нервной системой и цифровыми вычислительными машинами, состоящее в том, что в обоих случаях используется электричество, сводится лишь к весьма поверхностной аналогии. Если мы действительно хотим открыть глубокие связи, нам, скорее, следует искать сходство в математических моделях функционирования нервной системы и цифровых вычислительных машин.

V. Универсальность цифровых вычислительных машин

Рассмотренные в предыдущем разделе цифровые вычислительные машины можно отнести к классу «машин с дискретными состояниями». Так называются машины, работа которых складывается из совершающихся последовательно одна за другой резких смен их состояния. Состояния, о которых идет речь, достаточно отличны друг от друга, для того чтобы можно было пренебречь возможностью принять по ошибке одно из них за другое. Строго говоря, таких машин не существует. В действительности всякое движение непрерывно. Однако имеется много видов машин, которые удобно считать машинами с дискретными состояниями.

Например, если рассматривать выключатели осветительной сети, то удобно считать, отвлекаясь от действительного положения дела, что каждый выключатель может быть либо включен, либо выключен. То, что выключатель фактически имеет также и промежуточные состояния, несущественно для наших целей, и мы можем об этом забыть. Приведу пример машины с дискретными состояниями. Рассмотрим колесико, способное через каждую секунду совершать скачкообразный поворот (щелчок) на 120°, но которое можно застопоривать с помощью рычажка, управляемого извне. Пусть, кроме того, когда колесико принимает какое-нибудь определенное положение (одно из трех возможных для него), загорается лампочка. В абстрактном виде эта машина выглядит так. Внутреннее состояние машины (которое задается положением колесика) может быть qi q2 или q3. На вход машины подается либо сигнал i0, либо сигнал ii (положения рычажка). Внутреннее состояние в любой момент определено предыдущим состоянием и сигналом на входе согласно следующей таблице:

Сигналы на выходе, единственно видимые извне проявления внутреннего состояния (загорание лампочки), задаются таблицей:

Этот пример типичен для машин с дискретными состояниями. Такие машины можно описывать с помощью таблиц, при условии что они обладают конечным числом возможных состояний.

Очевидно, что при заданном начальном состоянии машины и заданном сигнале на входе всегда возможно предсказать все будущие состояния. Это напоминает точку зрения Лапласа, утверждавшего, что если известны положения и скорости всех частиц во вселенной в некоторый момент времени, то из такого полного описания ее состояния можно предсказать все ее будущие состояния. Однако то предсказание будущего, о котором у нас идет речь, гораздо ближе к практическому осуществлению, чем то, которое имел в виду Лаплас. Система «вселенной как единого целого» такова, что даже очень небольшие отклонения в начальных состояниях могут иметь решающее значение в последующем. Смещение одного электрона на одну миллиардную долю сантиметра в некоторый момент времени может явиться причиной того, что через год человек будет убит обвалом в горах. Существенной особенностью тех механических систем, которые мы назвали «машинами с дискретными состояниями», является то, что в них это явление не имеет места. Даже если вместо идеализированных машин взять реальные физические машины, то точное (в разумных пределах) знание о состоянии машины в один момент времени позволяет нам с разумной степенью точности предсказать любое число ее состояний в последующем.

Как мы уже упоминали, цифровые вычислительные машины относятся к классу машин с дискретными состояниями. Но число состояний, в которых может находиться такая машина, обычно велико. Например, число состояний машины, работающей в настоящее время в Манчестере, равно приблизительно 2 165 000, т. е. почти 1 050 000. Сравните эту величину с числом состояний описанного выше «щелкающего» колесика. Нетрудно понять, почему число состояний вычислительной машины оказывается столь огромным. В вычислительной машине имеется запоминающее устройство, соответствующее бумаге, которой пользуется человек-вычислитель. Запоминающее устройство должно быть таково, чтобы в нем можно было записать любую комбинацию символов, которая может быть написана на бумаге. Для простоты допустим, что в качестве символов используются только цифры от 0 до 9. Различия в почерках не принимаются во внимание. Допустим, что человек-вычислитель располагает 100 листами бумаги, разграфленными на 50 строк каждый. Строка может вместить 30 цифр. Число состояний в этом случае равно 10 100 × 50 × 30, т. е. 10 150 000. Это приблизительно равно числу состояний трех Манчестерских машин, взятых вместе. Логарифм числа состояний по основанию 2 обычно называют «емкостью памяти» машины. Например, Манчестерская машина обладает емкостью памяти около 165 000, а машина с колесиком из нашего примера — около 1,6. Если две машины соединены вместе, то емкость памяти объединенной машины представляет собой сумму емкостей памяти составляющих машин. Это позволяет формулировать такие утверждения, как «Манчестерская машина содержит 64 магнитных трека (направляющих приспособлений) каждый емкостью по 2560, восемь электронно-лучевых трубок емкостью по 1280. Число различных запоминающих устройств доходит до 300, что в целом приводит к емкости памяти в 174 380 единиц».

Если задана таблица, соответствующая некоторой машине с дискретными состояниями, то можно предсказать на будущее, что будет делать эта машина. Нет причин, по которым эти вычисления не могли бы выполняться с помощью цифровой вычислительной машины. Если бы с помощью цифровой вычислительной машины можно было достаточно быстро производить вычисления, то ее можно было бы использовать для имитации поведения любой машины с дискретными состояниями. В «игре в имитацию» тогда могли бы участвовать: машина с дискретными состояниями (которая играла бы за В) и имитирующая ее цифровая вычислительная машина (в качестве A), и задающий вопросы не смог бы отличить их друг от друга. Разумеется, для этого необходимо, чтобы цифровая вычислительная машина имела надлежащую емкость памяти, а также работала достаточно быстро. Кроме того, ее пришлось бы снабжать новой программой для каждой новой машины, которую она должна была бы имитировать.

Именно это особое свойство цифровых вычислительных машин — то, что они могут имитировать любую машину с дискретными состояниями, и имеют в виду, когда говорят, что цифровые вычислительные машины являются универсальными машинами. Из того, что имеются машины, обладающие свойством универсальности, вытекает важное следствие: чтобы выполнять различные вычислительные процедуры, нам вовсе не нужно создавать все новые и новые разнообразные машины (если отвлечься от растущих требований к быстроте вычислений). Все вычисления могут быть выполнены с помощью одной-единственной цифровой вычислительной машины, если снабжать ее надлежащей программой для каждого случая. В дальнейшем мы увидим в качестве следствия из этого результата, что все цифровые вычислительные машины в каком-то смысле эквивалентны друг другу.

Теперь мы можем вернуться к вопросу, поднятому нами в конце раздела III. Там мы высказали предположение, что вопрос «Могут ли машины мыслить?» можно заменить вопросом «Существуют ли воображаемые цифровые вычислительные машины, которые могли бы хорошо играть в имитацию?». Если угодно, мы можем придать этому вопросу видимость еще большей общности и спросить: «Существуют ли машины с дискретными состояниями, которые могли бы хорошо играть в эту игру?» Но в свете того, что цифровые вычислительные машины универсальны, мы видим, что любой из этих вопросов эквивалентен следующему: «Если взять только одну конкретную цифровую вычислительную машину Ц, то спрашивается: справедливо ли утверждение о том, что, изменяя емкость памяти этой машины, увеличивая скорость ее действия и снабжая ее подходящей программой, можно заставить Ц удовлетворительно исполнять роль А в “игре в имитацию” (причем роль В будет исполнять человек)?»

VI. Противоположные точки зрения по основному вопросу

Теперь мы можем считать, что основные понятия нами выяснены, и перейти к рассмотрению вопроса «Могут ли машины мыслить?» и его варианта, изложенного в конце предыдущего раздела. Вместе с тем мы не можем отказаться и от первоначальной формы вопроса, так как по поводу равноценности замены одной формы вопроса другой мнения могут расходиться, и в любом случае необходимо выслушать то, что было бы сказано в этой связи.

Читателю будет легче разобраться в этой дискуссии, если я сначала разъясню свои собственные убеждения. Рассмотрим сперва более точную форму вопроса. Я уверен, что лет через пятьдесят станет возможным программировать работу машин с емкостью памяти около 109, так чтобы они могли играть в имитацию настолько успешно, что шансы среднего человека установить присутствие машины через пять минут после того, как он начнет задавать вопросы, не поднимались бы выше 70 %. Первоначальный вопрос «Могут ли машины мыслить?» я считаю слишком неосмысленным, чтобы он заслуживал рассмотрения. Тем не менее я убежден, что к концу нашего века употребление слов и мнения, разделяемые большинством образованных людей, изменятся настолько, что можно будет говорить о мыслящих машинах, не боясь, что тебя поймут неправильно. Более того, я считаю вредным скрывать такие убеждения. Широко распространенное представление о том, что ученые с неуклонной последовательностью переходят от одного вполне установленного факта к другому, не менее хорошо установленному факту, не давая увлечь себя никакому непроверенному предположению, в корне ошибочно. Не будет никакого ущерба от того, что мы ясно осознаем, что является доказанным фактом, а что — предположением. Догадки очень важны, ибо они подсказывают направления, полезные для исследований.

Теперь я перехожу к рассмотрению мнений, противоположных моему собственному.

«Мышление есть свойство бессмертной души человека. Бог дал бессмертную душу каждому мужчине и каждой женщине, но не дал души никакому другому животному или машинам. Следовательно, ни животное, ни машина не могут мыслить».