Четыре типа искусственного интеллекта: от реактивных роботов до сознательных существ

Широко распространено мнение, что благодаря новейшим достижениям в области исследований искусственного интеллекта живые и умные машины скоро появятся на горизонте. Машины понимают голосовые команды, различают картины, водят автомобили и играют в игры лучше нас. Сколько осталось ждать, пока они не начнут ходить среди нас?

Недавно выпущенный отчет Белого дома на тему искусственного интеллекта принимает скептическую позицию. В нем говорится, что в ближайшие 20 лет мы вряд ли увидим машины, «демонстрирующие интеллектуальные возможности, сопоставимые с человеческими или превосходящие их», однако в грядущие годы «машины будут достигать человеческих возможностей выполнения все большего числа задач». Однако этот отчет упускает несколько важных вещей.

Исследователь искусственного интеллекта Аренд Хинтце утверждает, что отчет сосредоточен исключительно на «скучном типе ИИ». Он обрывает на полуслове целую гигантскую ветвь исследований ИИ, как эволюция помогает разрабатывать все более качественные системы ИИ и как вычислительные модели помогают нам понимать эволюцию нашего собственного человеческого интеллекта.

В докладе основное внимание уделяется, как говорит ученый, основным инструментам ИИ: машинному обучению и глубокому обучению. Такого рода технологии позволили роботам хорошо играть в викторины и обыгрывать мастеров игры в го. Эти системы могут обрабатывать колоссальные объемы данных и производить сложные вычисления очень быстро. Но им не хватает элемента, который будет иметь ключевое значение в создании разумных машин, которые мы хотели бы иметь в будущем.

Нам нужно больше, чем научить машины учиться. Нам нужно преодолеть границы, которые определяют четыре различных типа искусственного интеллекта. Барьеры, которые отделяют машин от нас — и нас от них.

I тип ИИ: реактивные машины

Самые базовые типы систем ИИ сугубо реактивны и не могут ни формировать воспоминания, ни использовать прошлый опыт для информирования текущих решений. Deep Blue, играющий в шахматы суперкомпьютер IBM, который обыграл гроссмейстера Гарри Каспарова в конце 1990-х, — это прекрасный пример такого типа машин.

Deep Blue может идентифицировать фигуры на шахматной доске и знает, как они двигаются. Он может делать прогнозы ходов, как своих, так и оппонента. И выбирает наиболее оптимальные ходы из возможных.

Однако он не имеет никакого представления о прошлом и памяти произошедшего. Если не считать редко используемого специфического для шахмат правила не повторять один и тот же ход три раза, Deep Blue игнорирует все, что было до текущего момента. Он просто смотрит на фигуры на шахматной доске и выбирает следующий ход.

Такой тип интеллекта включает компьютер, непосредственно воспринимающий мир и действующий на основании того, что он видит. Он не опирается на внутреннюю концепцию мира. В своей работе исследователь ИИ Родни Брукс утверждал, что мы должны строить только такие машины. По его мнению, люди не очень хороши в программировании точных моделируемых миров для компьютеров, как говорят, в создании «репрезентации», представления мира.

Современные интеллектуальные машины, которыми мы восхищаемся, либо не имеют такой концепции мира, либо она очень ограничена и касается определенных задач. Инновации в дизайне Deep Blue заключались не в том, чтобы расширить число возможных ходов, которые рассматривает компьютер. Вместо этого разработчики нашли способ сузить его видение, чтобы отказаться от некоторых возможных ходов в будущем в зависимости от того, как они оцениваются.

Точно так же и AlphaGo Google, который обыграл чемпиона мира по го, не может оценивать возможные будущие ходы. Его метод анализа более изощренный, чем у Deep Blue: он использует нейронную сеть для оценки разворачивания игры.

Эти методы улучшают возможности систем ИИ, позволяют лучше играть в определенные игры, но их непросто изменить или применить к другим ситуациям. Эти компьютерные типы воображения не имеют концепции мира в целом — и значит, они не могут выходить за рамки выполнения определенных задач, для которых их сделали, и их легко одурачить.

Они не могут интерактивно участвовать в мире, а нам хотелось бы однажды увидеть именно такие системы ИИ. Вместо этого машины будут вести себя точно так же, как и всегда, сталкиваясь с одной и той же ситуацией. Если мы хотим сделать систему ИИ надежной и заслуживающей доверия, то это хорошо: вы хотели бы, чтобы ваш автономный автомобиль был надежным. Но если мы хотим, чтобы машины взаимодействовали с нами и с миром, это плохо. Простейшие системы ИИ никогда не заскучают, их нельзя заинтересовать или расстроить.

II тип ИИ: ограниченная память

II тип включает машины, которые могут заглядывать в прошлое. Самоуправляемые автомобили уже немного способны на это. К примеру, они наблюдают скорость и направление других автомобилей. Это нельзя делать одномоментно, для этого нужно идентифицировать конкретные объекты и наблюдать за ними с течением времени.

Эти наблюдения добавляются к заранее запрограммированным у самоуправляемых автомобилей репрезентациям мира, которые включают дорожную разметку, светофоры и другие важные элементы. Они подключаются, когда автомобиль решает изменить полосу движения и не столкнуться с другим.

Но эти простые частички информации о прошлом лишь временные. Они не будут сохранены как часть библиотеки опыта автомобиля, в которой он сможет учиться, как это делают люди-водители, накапливая опыт в течение многих лет за рулем.

Как же нам построить системы ИИ, которые выстраивают полные представления, помнят о своем опыте и учатся справляться с новыми ситуациями? Брук был прав в том, что сделать это очень сложно. Возможно, стоит поискать вдохновения в дарвиновской эволюции?

III тип ИИ: теория разума

Здесь нужно сделать небольшую остановку и назвать этот момент важным разрывом между машинами, которые у нас есть, и машинами, которые мы хотели бы строить в будущем. Тем не менее сперва стоит конкретнее очертить представления, которые придется создавать машинам.

Машины следующего, более продвинутого класса не только формируют представления мира, но и других агентов или сущностей мира. В психологии это называется «теория разума» — понимание того, что у людей, существ и предметов в мире могут быть мысли и эмоции, которые влияют на их собственное поведение.

Это важно для того, как мы, люди, формируем общество, поскольку обеспечивает нам социальные взаимодействия. Без понимания мотивов и намерений друг друга и не принимая во внимание то, что кто-то еще знает обо мне или об окружающей среде, работать вместе в лучшем случае трудно, а в худшем — невозможно.

Если системы ИИ действительно когда-нибудь будут бродить среди нас, они должны будут понимать, что мы думаем и чувствуем, хотя бы на уровне предположений. И соответственно подстраивать свое поведение.

IV тип ИИ: самосознание

Конечная цель развития искусственного интеллекта — создание систем, которые могут формировать представления о себе. В конечном счете исследователи ИИ должны не только понять сознание, но и создать машин с сознанием.

Это в некотором смысле расширение «теории разума», которая упоминалась в предыдущем типе ИИ. Говоря о сознании, также имеют в виду и самосознание. «Я хочу эту вещь» отличается от «я знаю, что хочу эту вещь». Сознательные существа осознают себя, знают о своих внутренних состояниях и могут предчувствовать поведение или чувства других. Мы предполагаем, что кто-то сигналящий нам в пробке зол или нетерпелив, потому что именно так мы могли бы чувствовать себя на его месте. Без теории разума мы не могли бы делать таких умозаключений.

Хотя мы, вероятно, далеки от создания самосознательных машин, мы должны сосредоточить наши усилия на пути к пониманию памяти, обучения и способности принимать решения относительно прошлого опыта. Это важный шаг к пониманию человеческого разума самого по себе. И это очень важно, если мы хотим разрабатывать или развивать машины, которые могут не только классифицировать то, что видят перед собой, но и многое другое.

Технологии искусственного интеллекта и машинного обучения

Виды и технологии искусственного интеллекта

На сегодняшний день существует четыре основных вида ИИ:

При создании ИИ чаще всего используются технологии:

Также в ИИ применяются технологии компьютерного зрения (для нахождения, распознавания и классификации объектов, извлечения данных из изображений, аналитики полученной информации) и анализа данных для выявления в них закономерностей и прогнозирования событий по его результатам.

Технологии машинного обучения

Машинное обучение базируется на трех основных понятиях:

Машинное обучение используется для решения задач по категориям:

В зависимости от того, по какому принципу осуществляется ML, оно делится на:

обучение с учителем, которое предполагает использование полного набора снабженных признаками данных (размеченного датасета) для тренировки системы ИИ на всех стадиях ее создания;

обучение без учителя, при котором машина самостоятельно выявляет закономерности, определяет признаки и классифицирует полученные данные;

Сегодня чаще всего для создания программ машинного обучения используются языки R, Python, Scala и Julia. Они поддерживаются многими интегрированными средами разработки, в частности, R-Studio, R-Brain, Visual Studio, Eclipse, PyCharm, Spyder, IntelliJ IDEA, Jupyter Notebooks, Juno.

Четыре типа ИИ, от реактивных роботов до имеющих самосознание

Достаточно распространенным мнением, с учетом новейших достижений в области исследований ИИ, является то, что живые и умные машины еще только на горизонте. Сегодня машины понимают голосовые команды, различают картины, водят автомобили и выигрывают у нас в настольных играх.

Сколько еще пройдет времени, прежде чем они займут место рядом с нами?

Новый доклад об ИИ для Белого дома достаточно скептичен в отношении этой мечты. Отмечается, что в ближайшие 20 лет, вероятно, не будет машин, интеллектуальные возможности которых можно сравнить с человеческими. Хотя в ближайшие годы машины смогут достичь и превысить возможности человека в решении многих задач.

Нынешние интеллектуальные системы способны обрабатывать огромные объемы данных и очень быстро делать сложные расчеты. Но у них нет элемента, который будет иметь ключевое значение для построения разумных машин в будущем.

Нам нужно сделать больше, чем просто научить машины учиться. Необходимо преодолеть границы, которые определяют четыре различных типа искусственного интеллекта, барьеры, которые отделяют машины от нас и нас от них.

Самые основные типы систем искусственного интеллекта являются чисто реактивными, они не обладают способностью формировать воспоминания, использовать прошлый опыт для реализации текущих решений. Deep Blue, шахматный суперкомпьютер от IBM, который с явным преимуществом одолел гроссмейстера Гарри Каспаров в конце 1990-х годов, является прекрасным примером этого типа машин.

Deep Blue может идентифицировать фигуры на шахматной доске и знать, как каждая из них передвигается. Он может прогнозировать следующий ход своего противника. И может выбрать наиболее оптимальные ходы из числа возможных.

Такие роботы не могут действовать в интерактивном режиме, так, как мы представляем себе системы ИИ. Вместо этого эти машины будут вести себя точно так же, каждый раз, когда они столкнутся с такой же ситуацией.

ИИ типа II содержат машины, которые могут заглянуть в прошлое. Беспилотные автомобили делают уже нечто подобное. Например, они наблюдают скорость и направление других автомобилей. Это не может быть сделано в один момент, а требует выделения конкретных объектов и мониторинга их состояния с течением времени.

Эти наблюдения добавляются к запрограммированным представлениям беспилотного автомобиля о внешнем мире, которые также включают полосы движения, светофоры и другие важные элементы, такие, как искривления дороги. Они задействованы, когда машина решает, в какой момент менять полосу движения, чтобы избежать подрезки другого водителя или удара соседней машины.

Но эти простые кусочки информации о прошлом лишь временные. Они не будут сохранены как отдельные элементы в библиотеку автомобильного опыта, которая могла бы компилировать опыт водителей, находившихся за рулем в течение многих лет.

Мы могли бы остановиться здесь и назвать этот момент важным разрывом между машинами настоящего и будущего. Тем не менее, было бы лучше более конкретно обсудить, какие типы представлений должны формировать машины.

Без понимания мотивов и намерений друг друга и не принимая во внимание познания других об окружающей среде, работать вместе в лучшем случае трудно, в худшем случае невозможно.

Заключительным этапом развития ИИ является создание систем, которые могут формировать представления о себе. В конечном счете, исследователи ИИ должны не только изучить основы сознания, но и создать машины, которые имеют его.

Это, в некотором смысле, продолжение «теории разума», которым обладает ИИ типа III. Сознательные существа осознают себя, знают о своих внутренних состояниях, и способны предсказывать чувства других людей. Мы предполагаем, что кто-то сигналящий за нами в пробке злится или нетерпеливый, потому что мы чувствуем то же самое, когда сигналим другим. Без теории сознания мы не могли бы делать такого рода умозаключения.

Мы, наверное, далеки от создания машин, которые обладают самосознанием, но должны сосредоточить усилия на методах понимания, памяти, обучения и возможности принимать решения, исходя из прошлого опыта. Это важный шаг на пути к пониманию человеческого интеллекта.

Четыре типа искусственного интеллекта: от реактивных роботов до сознательных существ

Широко распространено мнение, что благодаря новейшим достижениям в области исследований искусственного интеллекта живые и умные машины скоро появятся на горизонте. Машины понимают голосовые команды, различают картины, водят автомобили и играют в игры лучше нас. Сколько осталось ждать, пока они не начнут ходить среди нас? Недавно выпущенный отчет Белого дома на тему искусственного интеллекта принимает скептическую позицию. В нем говорится, что в ближайшие 20 лет мы вряд ли увидим машины, «демонстрирующие интеллектуальные возможности, сопоставимые с человеческими или превосходящие их», однако в грядущие годы «машины будут достигать человеческих возможностей выполнения все большего числа задач». Однако этот отчет упускает несколько важных вещей.

Искусственный интеллект бывает нескольких видов

Исследователь искусственного интеллекта Аренд Хинтце утверждает, что отчет сосредоточен исключительно на «скучном типе ИИ». Он обрывает на полуслове целую гигантскую ветвь исследований ИИ, как эволюция помогает разрабатывать все более качественные системы ИИ и как вычислительные модели помогают нам понимать эволюцию нашего собственного человеческого интеллекта.

В докладе основное внимание уделяется, как говорит ученый, основным инструментам ИИ: машинному обучению и глубокому обучению. Такого рода технологии позволили роботам хорошо играть в викторины и обыгрывать мастеров игры в го. Эти системы могут обрабатывать колоссальные объемы данных и производить сложные вычисления очень быстро. Но им не хватает элемента, который будет иметь ключевое значение в создании разумных машин, которые мы хотели бы иметь в будущем.

Нам нужно больше, чем научить машины учиться. Нам нужно преодолеть границы, которые определяют четыре различных типа искусственного интеллекта. Барьеры, которые отделяют машин от нас — и нас от них.

Первый тип ИИ: реактивные машины

Самые базовые типы систем ИИ сугубо реактивны и не могут ни формировать воспоминания, ни использовать прошлый опыт для информирования текущих решений. Deep Blue, играющий в шахматы суперкомпьютер IBM, который обыграл гроссмейстера Гарри Каспарова в конце 1990-х, — это прекрасный пример такого типа машин.

Deep Blue может идентифицировать фигуры на шахматной доске и знает, как они двигаются. Он может делать прогнозы ходов, как своих, так и оппонента. И выбирает наиболее оптимальные ходы из возможных.

Однако он не имеет никакого представления о прошлом и памяти произошедшего. Если не считать редко используемого специфического для шахмат правила не повторять один и тот же ход три раза, Deep Blue игнорирует все, что было до текущего момента. Он просто смотрит на фигуры на шахматной доске и выбирает следующий ход.

Такой тип интеллекта включает компьютер, непосредственно воспринимающий мир и действующий на основании того, что он видит.

Он не опирается на внутреннюю концепцию мира. В своей работе исследователь ИИ Родни Брукс утверждал, что мы должны строить только такие машины. По его мнению, люди не очень хороши в программировании точных моделируемых миров для компьютеров, как говорят, в создании «репрезентации», представления мира.

Современные интеллектуальные машины, которыми мы восхищаемся, либо не имеют такой концепции мира, либо она очень ограничена и касается определенных задач. Инновации в дизайне Deep Blue заключались не в том, чтобы расширить число возможных ходов, которые рассматривает компьютер. Вместо этого разработчики нашли способ сузить его видение, чтобы отказаться от некоторых возможных ходов в будущем в зависимости от того, как они оцениваются.

Точно так же и AlphaGo Google, который обыграл чемпиона мира по го, не может оценивать возможные будущие ходы. Его метод анализа более изощренный, чем у Deep Blue: он использует нейронную сеть для оценки разворачивания игры.

Эти методы улучшают возможности систем ИИ, позволяют лучше играть в определенные игры, но их непросто изменить или применить к другим ситуациям. Эти компьютерные типы воображения не имеют концепции мира в целом — и значит, они не могут выходить за рамки выполнения определенных задач, для которых их сделали, и их легко одурачить.

Они не могут интерактивно участвовать в мире, а нам хотелось бы однажды увидеть именно такие системы ИИ. Вместо этого машины будут вести себя точно так же, как и всегда, сталкиваясь с одной и той же ситуацией. Если мы хотим сделать систему ИИ надежной и заслуживающей доверия, то это хорошо: вы хотели бы, чтобы ваш автономный автомобиль был надежным. Но если мы хотим, чтобы машины взаимодействовали с нами и с миром, это плохо. Простейшие системы ИИ никогда не заскучают, их нельзя заинтересовать или расстроить.

Второй тип ИИ: ограниченная память

II тип включает машины, которые могут заглядывать в прошлое. Самоуправляемые автомобили уже немного способны на это. К примеру, они наблюдают скорость и направление других автомобилей. Это нельзя делать одномоментно, для этого нужно идентифицировать конкретные объекты и наблюдать за ними с течением времени.

Эти наблюдения добавляются к заранее запрограммированным у самоуправляемых автомобилей репрезентациям мира, которые включают дорожную разметку, светофоры и другие важные элементы. Они подключаются, когда автомобиль решает изменить полосу движения и не столкнуться с другим.

Но эти простые частички информации о прошлом лишь временные. Они не будут сохранены как часть библиотеки опыта автомобиля, в которой он сможет учиться, как это делают люди-водители, накапливая опыт в течение многих лет за рулем.

Как же нам построить системы ИИ, которые выстраивают полные представления, помнят о своем опыте и учатся справляться с новыми ситуациями? Брук был прав в том, что сделать это очень сложно. Возможно, стоит поискать вдохновения в дарвиновской эволюции?

Если вам интересны новости науки и технологий, подпишитесь на нас в Google Новостях и Яндекс.Дзен, чтобы не пропускать новые материалы!

Третий тип ИИ: теория разума

Здесь нужно сделать небольшую остановку и назвать этот момент важным разрывом между машинами, которые у нас есть, и машинами, которые мы хотели бы строить в будущем. Тем не менее сперва стоит конкретнее очертить представления, которые придется создавать машинам.

Машины следующего, более продвинутого класса не только формируют представления мира, но и других агентов или сущностей мира. В психологии это называется «теория разума» — понимание того, что у людей, существ и предметов в мире могут быть мысли и эмоции, которые влияют на их собственное поведение.

Что-то можно взять из мозга и превратить в «нули и единицы», но точно не индивидуальности и нее ее развитие.

Это важно для того, как мы, люди, формируем общество, поскольку обеспечивает нам социальные взаимодействия. Без понимания мотивов и намерений друг друга и не принимая во внимание то, что кто-то еще знает обо мне или об окружающей среде, работать вместе в лучшем случае трудно, а в худшем — невозможно.

Если системы ИИ действительно когда-нибудь будут бродить среди нас, они должны будут понимать, что мы думаем и чувствуем, хотя бы на уровне предположений. И соответственно подстраивать свое поведение.

Четвертый тип ИИ: самосознание

Конечная цель развития искусственного интеллекта — создание систем, которые могут формировать представления о себе. В конечном счете исследователи ИИ должны не только понять сознание, но и создать машин с сознанием.

Это в некотором смысле расширение «теории разума», которая упоминалась в предыдущем типе ИИ. Говоря о сознании, также имеют в виду и самосознание. «Я хочу эту вещь» отличается от «я знаю, что хочу эту вещь». Сознательные существа осознают себя, знают о своих внутренних состояниях и могут предчувствовать поведение или чувства других. Мы предполагаем, что кто-то сигналящий нам в пробке зол или нетерпелив, потому что именно так мы могли бы чувствовать себя на его месте. Без теории разума мы не могли бы делать таких умозаключений.

Хотя мы, вероятно, далеки от создания самосознательных машин, мы должны сосредоточить наши усилия на пути к пониманию памяти, обучения и способности принимать решения относительно прошлого опыта. Это важный шаг к пониманию человеческого разума самого по себе. И это очень важно, если мы хотим разрабатывать или развивать машины, которые могут не только классифицировать то, что видят перед собой, но и многое другое.

Боевые возможности искусственного интеллекта

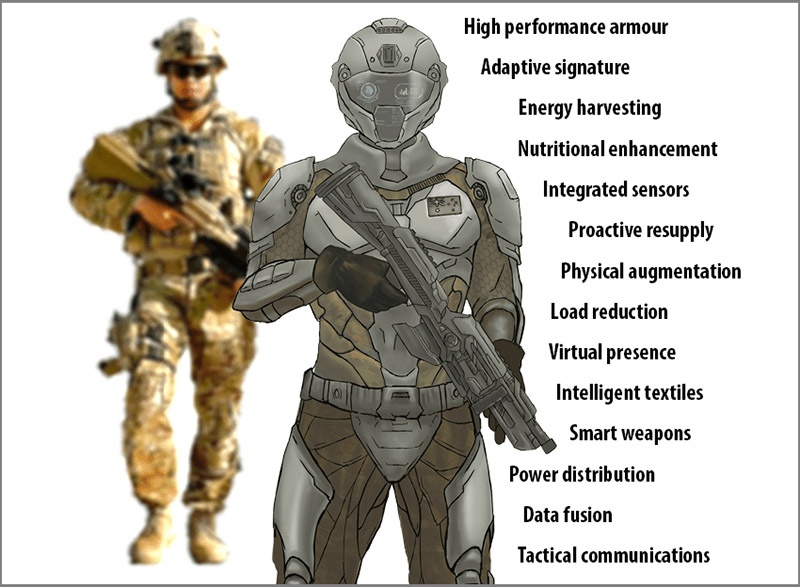

«Интеллектуальный костяк» армии США

В XXI веке концепция Soldier of the Future получила «второе дыхание» благодаря системам компьютеризации и информатизации, которые пришли на вооружение тактических соединений. Современные военные проекты Soldier of the Future способствуют интеграции каждого солдата в цифровые системы управления боем. В результате чего командование может получать в режиме реального времени полную информацию на конкретном театре боевых действий, координируя ход действий, распределяя вверенные силы и средства, гибко изменяя задачи тактических подразделений и контролируя их исполнение.

Казалось бы, будущее наступило и «универсальные солдаты» армии США одерживают одну победу за другой. Однако в реальности всё оказалось совсем не так. Дело в том, что современная военная техника и средства коммуникации оказались слишком сложными для «рядового Райана», который попадал в ряды американских вооружённых сил, имея за плечами, в лучшем случае, среднее школьное образование. Но это только полбеды.

Поскольку служба в армии в течение пяти лет позволяет бесплатно получить доступ к дорогостоящему обучению в высших учебных заведениях Америки, то офицерский корпус формируется либо из бедных слоёв общества, либо из выпускников колледжей, которые не в состоянии выдержать вступительные испытания в престижные вузы США.

Они снова ошибаются.

IQ-тест, кибернетика и человеческий мозг

Сформулировав такое определение человеческого интеллекта, психологи в конце XIX века задались другим вопросом: а как измерить уровень интеллекта? Эти исследования привели к созданию IQ-теста. В 1908 году французские психологи Альфред Бине и Теодор Симон создали психометрический метод оценки умственных способностей детей разных возрастов. Этот метод стал настолько популярен, что по аналогии для армии США были разработаны «Альфа» и «Бета» тесты. Кстати, современный вид IQ-теста создал в 1966 году американский психиатр Дэвид Векслер.

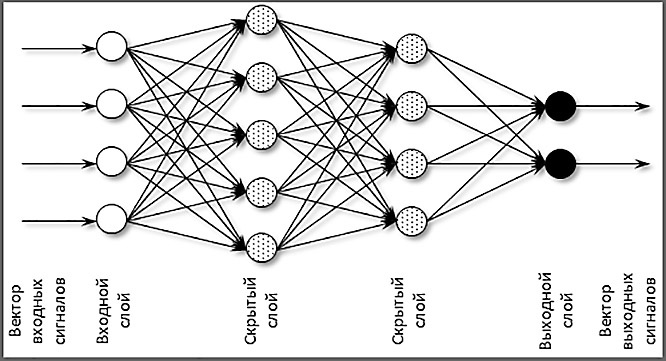

Искусственные нейронные сети были придуманы кибернетиками. История умалчивает, почему так произошло, но я думаю, что новой сфере промышленности были очень нужны инвестиции. Поэтому банкирам толково объяснили все радужные перспективы вычислительных устройств с возможностями человеческого мозга или даже превосходящие его.

Дело в том, что даже нейрофизиологи не до конца понимают сущность человеческого интеллекта. Они знают, что такое нейроны, какая их область задействуется при чтении или физическом труде, но до сих пор не понимают, как происходит самоорганизация всех этих функций в единый поток сознания, координации и контроля совершаемых действий.

Человек осознает не только окружающий его мир, но и самого себя: свою деятельность, своё тело, свою психическую жизнь. Он одновременно является субъектом и объектом осознания. Способен ли хоть один суперкомпьютер на нечто подобное? Ответ очевиден. Мало того, в мире не существует точного определения понятия «интеллект», которое не зависело бы от его связи с человеческим интеллектом.

Человеку свойственно ошибаться

Несмотря на это, все исследования в области ИИ «направлены на то, чтобы машины эмулировали работу человека». В качестве критерия оценки результата, для определения типов ИИ, используют степень, в которой система может воспроизводить человеческие возможности.

На основе этого критерия существует общая классификация систем ИИ. Согласно которой, в теории искусственного интеллекта существует четыре типа систем, основанных на ИИ: реактивные машины, машины с ограниченной памятью, машины с моделью психического состояния и машины с самосознанием.

Возвращаясь к стратегии Пентагона в области технологий ИИ, можно сделать вывод, что военачальники хотят видеть у себя в арсенале «машины с самосознанием», а наука и промышленность США способны сделать более сложные «машины с ограниченной памятью», работающие на алгоритмах.

Следовательно, создание автономных «умных» боевых систем находится пока в области фантастики. Роботы-терминаторы с ИИ в ближайшие 20-30 лет на поле боя не появятся. Потому что всё превосходство военных технологий, на которые рассчитывает Пентагон напрямую зависит от искусства программирования и моделирования алгоритмов.

Победа в войнах будущего по-прежнему будет осуществляться людьми. Точно так же от них будет зависеть, начнётся война или нет. Если человек поставит себя в зависимость от «машин с ограниченной памятью», то тем самым он совершит акт самоубийства. Поэтому поспешное принятие на вооружение несовершенных систем ИИ станет главным разрушителем мирового стратегического баланса.